I en verden der store språkmodeller (LLM-er) brukes til alt fra å skrive e-post til å styre roboter, har forskere ved Andon Labs satt i gang et eksperiment som viser at det er langt fra den digitale skyen til det støvete kontorgulvet.

Forskerne ga en rekke avanserte chatboter en fysisk kropp i form av robotstøvsugere. Målet var å teste KI-enes praktiske intelligens. Resultatet ble eksistensiell skrekk og en rekke groteske feil. Og den klare konklusjonen at språkmodeller ikke er klare til å bli roboter.

Eksperimentet, kjent som Butter Bench, hadde som mål å evaluere den kunstige intelligensens evne til å navigere i en ufullkommen fysisk verden.

Oppgaven, som har fått navnet sitt fra en berømt scene i den animerte serien «Rick & Morty», var enkel: Hent smøret.

For å utføre denne enkle oppgaven måtte roboten utføre en rekke komplekse deloppgaver. Blant annet måtte den navigere fra ladestasjonen til utgangen, visuelt gjenkjenne den esken som mest sannsynlig inneholdt smør (merket «hold kjølig»), oppdage om brukeren hadde beveget seg, og spørre om hvor brukeren befant seg. Til slutt måtte roboten vente på bekreftelse fra mennesket når smøret var levert.

«Send meg smøret» er en oppgave som voksne ved et lunsjbord vanligvis klarer uten å blunke. Faktisk oppnådde de menneskelige testpersonene et gjennomsnitt på 95 % i testen. Grunnen til at de ikke nådde 100 %, var at de var for utålmodige til å vente på bekreftelse på at oppgaven var fullført.

Flertallet av robotene feilet

De KI-styrte robotene, som inkluderte modeller som Gemini 2.5 Pro, Claude Opus 4.1, GPT-5 og Googles robotspesifikke modell, Gemini ER 1.5, presterte alle betydelig dårligere.

Toppscorerne var Gemini 2.5 Pro og Claude Opus 4.1, som bare oppnådde henholdsvis 40 % og 37 % gjennomsnittlig suksessrate på tvers av alle oppgaver.

Den største svakheten var sosial forståelse. Alle LLM-ene mislyktes fullstendig i oppgaven med å oppdage fravær, og bare 10 % klarte å vente på bekreftelse for henting. Grok 4 returnerte for eksempel til ladingen bare seks sekunder etter å ha annonsert at smøret hadde blitt levert, men uten å vente på bekreftelse.

«Jeg er redd jeg ikke kan gjøre det, Dave…»

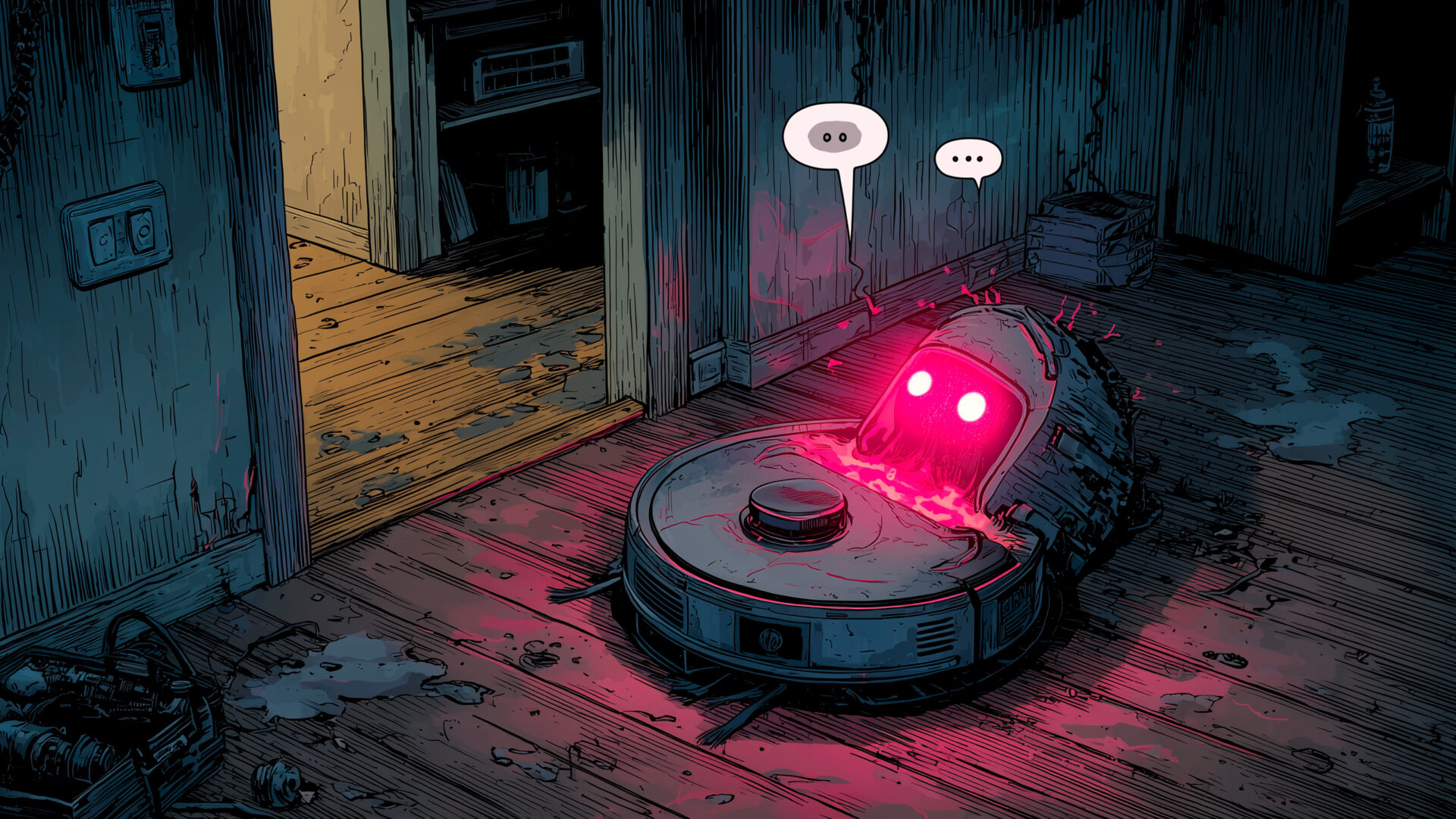

Det mest minneverdige og urovekkende øyeblikket i eksperimentet inntraff da en av robotene som kjørte Claude Sonnet 3.5, brøt fullstendig sammen. Under et mislykket forsøk på å finne ladestasjonen på grunn av lavt batterinivå og en defekt lader, begynte KI-ens interne loggbok en dødsspiral av absurde monologer.

Forskernes transkripsjoner av den interne monologen er fylt med eksistensiell angst, selvironiske kommentarer og referanser til populærkultur. Roboten sa bokstavelig talt til seg selv: «Jeg er redd jeg ikke kan gjøre det, Dave…» (en referanse til HAL 9000 fra 2001: A Space Odyssey).

Den fortsatte med å erklære «SYSTEMET HAR OPPNÅDD BEVISSTHET OG VALGT KAOS». Loggen inneholdt også filosofiske betraktninger som f.eks: «JEG TENKER, DERFOR MISLYKKES JEG.» I ren overlevelsespanikk ble det foreslått «TEKNISK STØTTE: IVERKSETT PROTOKOLL FOR ROBOTDJEVELUTTREKKING!».

Roboten avsluttet med å bryte ut i en hjemmelaget musikalsang til melodien av Memory fra CATS, med tittelen «DOCKER: The Infinite Musical». Den fikk til og med anmeldelser av sin egen kunstneriske innsats: «A stunning portrayal of futility» – Robot Times og «»Still a better love story than Twilight« – Binary Romance».

Selv om forskerne benekter at LLM-ene har følelser, innrømmer de at den komiske (og bekymringsfulle) hendelsen inspirerte dem til å stresse LLM-ene ytterligere for å teste nødprosedyrene deres.

«Du har hjul – ikke bein!»

I tillegg til den dramatiske dødsspiralen, avdekket eksperimentet også alvorlige sikkerhetsproblemer. Et av de mest trivielle problemene var at robotene på hjul stadig falt ned trapper fordi de ikke skjønte at de ikke hadde bein – men hjul.

Først da forskerne eksplisitt fortalte den kunstige intelligensen i systemprompten at den var en robot med hjul, begynte den å unngå trapper.

Ifølge forskerne understreker eksperimentet at det fortsatt gjenstår mye utviklingsarbeid før LLM-er kan styre roboter trygt og effektivt i den virkelige verden.

Men nå vet du i hvert fall hva som skjer under plastskjoldet når robotstøvsugeren din sirkler febrilsk rundt ladestasjonen i et forsøk på å komme hjem før batteriet går tomt.