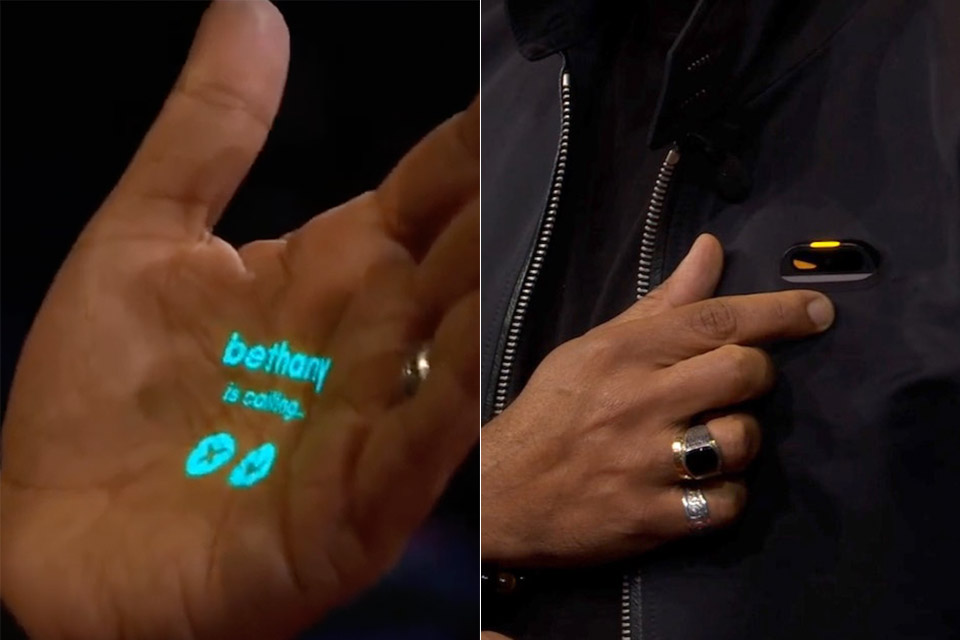

Tech-startup-selskapet Humane holdt nylig en TED talk hvor de demonstrerte en interessant AI-assistent. Denne enheten er selvstendig og ikke avhengig av en mobiltelefon, og man kan kommunisere med den ved hjelp av gester- eller stemmekommandoer. Om den trenger å vise noe, projiserer den bildet på en valgfri overflate.

En av grunnleggerne, Imran Chaudhri, forklarer at enheten får plass i brystlomma.

You don’t need a smartphone or any other device to pair with it. It interacts with the world the way you interact with the world, hearing what you hear, seeing what you see, while being privacy first, and safe, and completely fading into the background of your life.

I obtained a video of @Humane ‘s AI-powered wearable projector in action (clipped from a video @zarifali9 sent me of the #TED2023 by @imranchaudhri)

This looks insaneee! pic.twitter.com/DDOfTMCxH5

— Ray Wong (@raywongy) April 21, 2023

I demonstrasjonen ba Chaudhri om en oppsummering av et møte han hadde deltatt på, og enheten ga ham en rekke faktapunkter. Han mottok et anrop og fikk projisert informasjonen om samtalen i hånden før han svarte. Men det mest imponerende var nok da han holdt opp en godteribit og spurte AI-en «kan jeg spise denne?» og den advarte ham om at den inneholdt et stoff han var allergisk mot.

@humane‘s device helping you decide what you can and cannot eat based on knowing your preferences and dietary restrictions. pic.twitter.com/PFwEAsNxDI

— Michael Mofina (@MichaelMofina) April 21, 2023

Selskapet er på ingen måte nybegynnere i bransjen. Det ble grunnlagt i 2018 av Imran Chaudhri og Bethany Bonggiorno, som begge har bakgrunn fra Apple innen maskinvare og design. I mars måned alene samlet de inn hundre millioner dollar i finansiering for å fullføre produktutviklingen.